La historia de las ciencias de la computación es el estudio del desarrollo y evolución de las ideas, teorías, dispositivos y sistemas que permiten el procesamiento automático de información. Esta historia abarca desde los primeros métodos manuales y mecánicos para realizar cálculos, hasta las computadoras digitales modernas y tecnologías avanzadas como la inteligencia artificial, el internet y la computación cuántica.

Este campo analiza cómo la humanidad ha diseñado herramientas para representar, almacenar, transmitir y procesar información, y cómo ha evolucionado el pensamiento lógico, matemático y algorítmico que hace posible la programación y el funcionamiento de los sistemas computacionales.

¿Por que es importante?

Conocer esta historia nos ayuda a entender:

- Cómo llegamos a tener la tecnología que usamos hoy (como computadoras, celulares, IA).

- El trabajo de personas clave como Ada Lovelace, Alan Turing y John von Neumann.

- La evolución de ideas como los algoritmos, la inteligencia artificial o la seguridad informática.

1800

Fue una etapa fundamental en la historia de las ciencias de la computación, aunque todavía no existían las computadoras como las conocemos hoy. En este siglo se sentaron muchas de las bases teóricas y mecánicas que permitirían el desarrollo de las computadoras en el siglo XX. Un comerciante de textiles demostró que las maquinas podían ser controladas por sistemas binarios.

1936

En 1936, el matemático Alan Turing presentó la idea de la máquina de Turing, un modelo teórico capaz de resolver problemas siguiendo instrucciones precisas (algoritmos). Este concepto marcó el inicio de la computación moderna, ya que definió qué es un cálculo computable y cómo una máquina puede realizarlo.

También se demostró que no todos los problemas pueden resolverse con computadoras, lo que dio origen a la teoría de la computación.

Años '50

En la historia de las ciencias de la computación, los años 50 fueron una década crucial en la que las computadoras pasaron de ser prototipos experimentales a convertirse en herramientas útiles y utilizadas en distintos campos.

Años '60

Con la aparición del transistor, fue posible desarrollar circuitos electrónicos más eficientes, lo que mejoró notablemente el rendimiento de los computadores. Hacia mediados de los años 60, comenzó la llamada tercera generación de computadoras, marcada por el uso de circuitos integrados o chips, que consumían menos energía y eran mucho más compactos. Esto permitió reducir considerablemente el tamaño de los equipos, haciéndolos más rápidos, confiables y accesibles para diversas instituciones.

Años '70

Durante los años 70, la informática dio un gran salto con la cuarta generación de computadoras, gracias al uso de microprocesadores, que integraban miles de circuitos en un solo chip. En 1971, Intel lanzó el primer microprocesador comercial, el Intel 4004, lo que marcó el inicio de una nueva era: ahora era posible construir computadoras más pequeñas, rápidas y económicas.

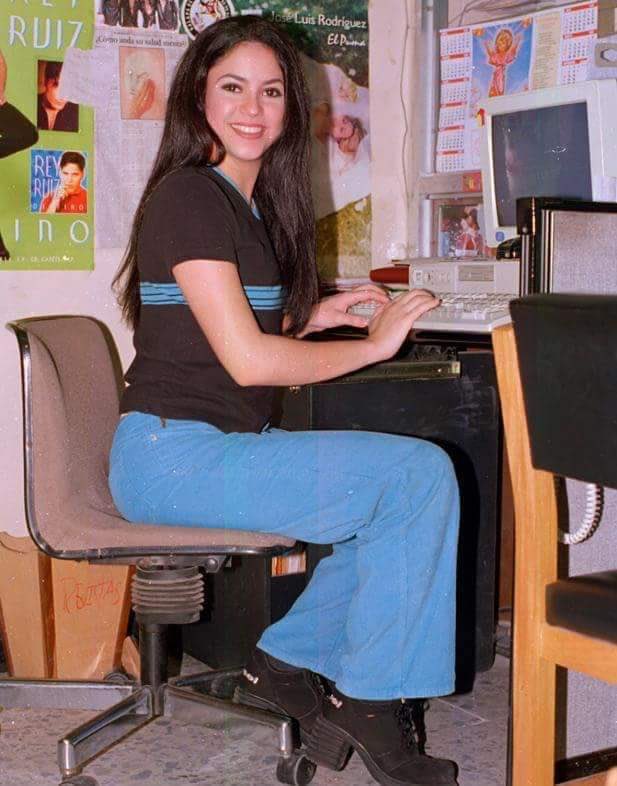

Durante los años 80 y 90 se dio paso a la llamada quinta generación de computadoras, caracterizada por la aparición de sistemas operativos con interfaz gráfica, como Windows y Mac OS, que facilitaron el uso de las computadoras a usuarios no expertos. Esta etapa también estuvo marcada por el nacimiento y expansión de Internet, lo que transformó la manera en que se accede y comparte la información a nivel global. Además, comenzaron a desarrollarse los computadores portátiles, haciendo que la tecnología fuera cada vez más accesible, práctica y móvil, y permitiendo que las personas pudieran trabajar, estudiar o comunicarse desde casi cualquier lugar.

BIBLIOGRAFIA

https://es.m.wikipedia.org/wiki/Historia_de_las_ciencias_de_la_computaci%C3%B3n

Consultado el 18 de diciembre de 2012.

Comentarios

Publicar un comentario